人工智能的三大支撑是硬件、算法和数据,其中硬件指的是运行AI算法的芯片与相对应的计算平台。在硬件方面,目前主要是使用GPU并行计算神经网络,同时,FPGA和ASIC也具有未来异军突起潜能。目前AI芯片按照使用场景可以分为:云端(服务器端)和终端(移动端)芯片。云端主要指公有云、私有云、数据中心等需要用到的神经网络专用服务器,终端指手机、车载、安防、音响、机器人等移动应用终端。有的厂商同时具备云端和终端芯片的设计能力。

机器学习不断演进,深度学习出现。人工智能是应用范畴的词汇,机器学习是目前最有效实现人工智能的方法。深度学习是机器学习的子类,也是现有机器学习方法中,最奏效的一类。

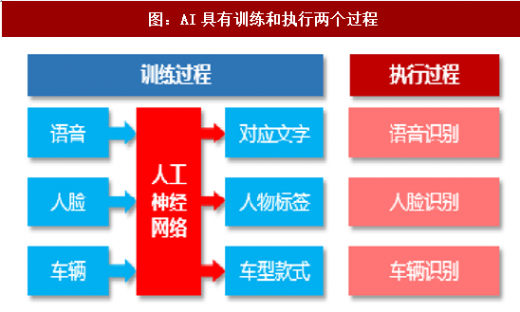

深度学习的人工神经网络算法与传统计算模式不同。它能够从输入的大量数据中自发的总结出规律,从而举一反三,泛化至从未见过的案例中。因此,它不需要人为地提取所需解决问题的特征或者总结规律来进行编程,是通过大量样本数据训练建立了输入数据和输出数据之间的映射关系,其最直接的应用是在分类识别方面。例如训练样本的输入是语音数据,训练后的神经网络实现的功能就是语音识别,如果训练样本输入是人脸图像数据,训练后实现的功能就是人脸识别。

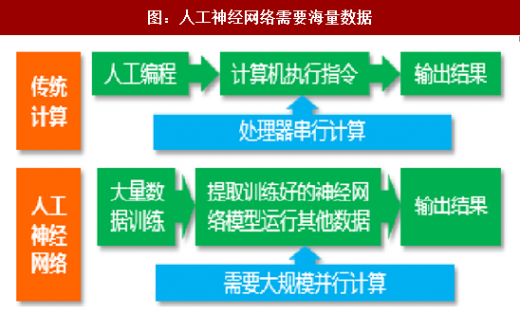

传统计算机软件是程序员根据所需要实现的功能原理编程,输入至计算机运行即可,其计算过程主要体现在执行指令这个环节。而深度学习的人工神经网络算法包含了两个计算过程:

1.训练:用已有的样本数据去训练人工神经网络。

2.执行:用训练好的人工神经网络去运行其他数据。

图:AI具有训练和执行两个过程

图:人工神经网络需要海量数据

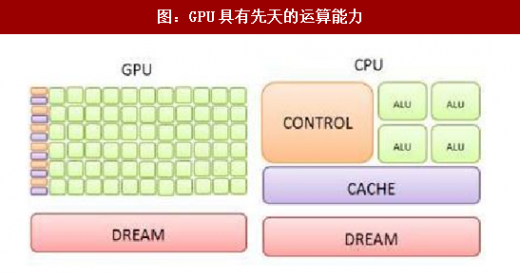

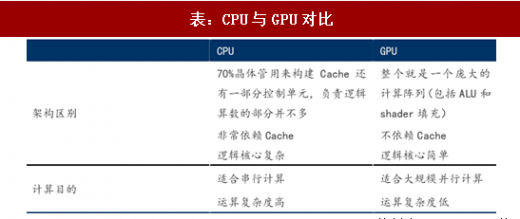

CPU基于低延时的设计,有强单次逻辑处理能力,但面对有限功耗的大量数据处理能力有限。中央处理器CPU需要很强的处理不同类型数据的计算能力以及处理分支与跳转的逻辑判断能力,这些都使得CPU的内部结构异常复杂。

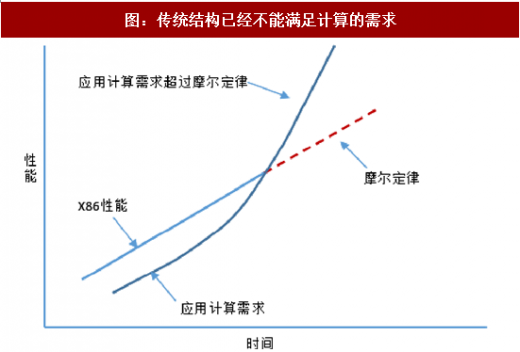

深度学习模型需要通过大量的数据训练才能获得理想的效果。骤然爆发的数据洪流满足了深度学习算法对于训练数据量的要求,但是算法的实现还需要相应处理器极高的运算速度作为支撑。当前流行的包括X86和ARM在内的传统CPU处理器架构往往需要数百甚至上千条指令才能完成一个神经元的处理,但对于并不需要太多的程序指令,却需要海量数据运算的深度学习的计算需求,这种结构就显得非常笨拙。尤其是在当前功耗限制下无法通过提升CPU主频来加快指令执行速度,这种矛盾愈发不可调和,深度学习需要一种替代硬件来满足海量数据的运算需求。

图:传统结构已经不能满足计算的需求

2、GPU:将最早受益于安防等需求爆发

(1)GPU最先被引入深度学习

GPU:图形加速起家,较成熟生态系统,最先被引入深度学习。GPU(GraphicsProcessingUnit)称为图形处理器,它是显卡的“心脏”,与CPU类似,只不过是一种专门进行图像运算工作的微处理器。GPU是专为执行复杂的数学和几何计算而设计的,这些计算是图形渲染所必需的。GPU在浮点运算、并行计算等部分计算方面可以提供数十倍乃至于上百倍于CPU的性能。英伟达公司从2006年下半年已经开始陆续推出相关的硬件产品以及软件开发工具,目前是人工智能硬件市场的主导。GPU对海量数据并行运算的能力与深度学习需求不谋而合,因此,被最先引入深度学习。2011年吴恩达教授率先将其应用于谷歌大脑中便取得惊人效果,结果表明,12颗英伟达的GPU可以提供相当于2000颗CPU的深度学习性能。在CPU上约有20%的晶体管是用作计算的,而GPU上有80%的晶体管用作计算。

参考观研天下发布《2018-2023年中国人工智能芯片市场发展现状与发展机遇分析报告》

(2)GPU局限性

GPU天然具有三个方面局限性。GPU作为图像处理器,设计初衷是为了应对图像处理中需要大规模并行计算。因此,其在应用于深度学习算法时,有三个方面的局限性:

1. 应用过程中无法充分发挥并行计算优势。深度学习包含训练和应用两个计算环节,

GPU在深度学习算法训练上非常高效,但在应用时一次性只能对于一张输入图像进行处理,并行度的优势不能完全发挥。

2. 硬件结构固定不具备可编程性。深度学习算法还未完全稳定,若深度学习算法发生大的变化,GPU无法像FPGA一样可以灵活的配置硬件结构

3. 运行深度学习算法能效远低于FPGA。学术界和产业界研究已经证明,GPU计算方式与深度学习算法并非完全匹配,性能峰值无法被完全利用。运行深度学习算法中实现同样的性能,GPU所需功耗远大于FPGA。例如国内初创企业深鉴科技基于FPGA平台的人工智能芯片在同样开发周期内相对GPU能效有一个数量级的提升。

3、FPGA:能效居中的中间方案

(1)FPGA的发展历程FPGA:能效中等、灵活度高、成本较高的AI白板。FPGA(Field-ProgrammableGateArray)称为现场可编程门阵列,用户可以根据自身的需求进行重复编程。FPGA比GPU具有更低的功耗,比ASIC具有更短的开发时间和更低的成本。自Xilinx在1984年创造出FPGA以来,在通信、医疗、工控和安防等领域占有一席之地,在过去几年也有极高的增长率。而进入了最近两年,由于云计算、高性能计算和人工智能的繁荣,拥有先天优势的FPGA的关注度更是到达了前所未有的高度。

(2)FPGA应用前景十分巨大目前来看,FPGA在两个领域的应用前景十分巨大:工业互联网领域、工业机器人设备领域。

作为未来制造业发展的方向,工业大数据、云计算平台、MES系统等都是支持工业智能化的重要平台,它们需要完成大数据量的复杂处理,FPGA在其中可以发挥重要作用。

在多轴向运作的精密控制、实时同步的连接以及设备多功能整合等方面,兼具弹性和整合性的FPGA,更能展现设计优势。如汽车ADAS需要对实时高清图像进行及时的分析识别与处理;在人工智能方面,深度学习神经网络也需要进行大量并行运算。

就目前的市场而言,英特尔、IBM、德州仪器、摩托罗拉、飞利浦、东芝、三星等巨头纷纷涉足FPGA,但最成功的是Xilinx与Altera。这两家公司共占有近90%的市场份额,专利达到6000余项。Intel在2015年以161亿美元收购了Altera,也是看中FPGA专用计算能力在人工智能领域的发展。从行业巨头巨头的动作可以看出,由于FPGA在计算能力和灵活性上大大弥补了CPU的短板,未来在深度学习领域,CPU+FPGA的组合将成为重要的发展方向。

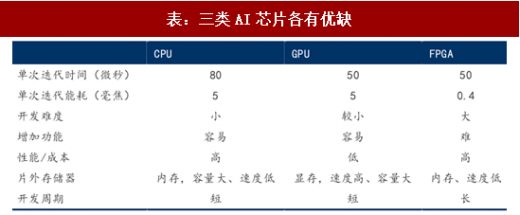

FPGA与GPU、CPU相比,具有性能高、能耗低、可硬件编程的特点:

性能:虽然FPGA的频率一般比CPU低,但是可以用FPGA实现并行度很大的硬件计算器。比如一般CPU每次只能处理4到8个指令,在FPGA上使用数据并行的方法可以每次处理256个或者更多的指令,因此FPGA的数据吞吐量远超CPU。

能耗:CPU的解码器通常会占总能耗的50%,而在GPU中,即使其解码器的部分相对较小,也会消耗10%-20%的能源。相比之下,由于FPGA内部结构没有解码器,加之FPGA的主频比CPU及GPU低很多,通常CPU和GPU的主频在1-3GHz之间,而FPGA的主频在500MHz以下,因此FPGA的能耗要远低于CPU及GPU。

可编程:FPGA支持硬件编程。FPGA能够使用户较为方便的设计出所需的硬件逻辑,而且可以进行静态重复编程和动态系统重配置,使系统的硬件功能可以向软件一样通过编程来修改,实现灵活而方便的更新和开发,大大提高系统设计的灵活性和通用性。

表:三类AI芯片各有优缺

(3)FPGA存在的局限

尽管FPGA倍受看好,甚至新一代百度大脑也是基于FPGA平台研发,微软、IBM等公司都有专门的FPGA团队为服务器加速,但其毕竟不是专门为了适用深度学习算法而研发,实际仍然存在不少局限:

1. 基本单元的计算能力有限。为了实现可重构特性,FPGA内部有大量极细粒度的基本单元,但是每个单元的计算能力(主要依靠LUT查找表)都远远低于CPU和GPU中的

ALU模块。

2. 速度和功耗有待提升。相对专用定制芯片ASIC,FPGA在处理速度和功耗方面仍然存在不小差距。

3. FPGA价格相对较为昂贵。在规模放量的情况下单块FPGA的成本要远高与ASIC,因此FPGA更适用于企业级用户,尤其是重配置、性能需求较高的军工和工业电子领域。

4、ASIC:能效顶级、拥抱未来

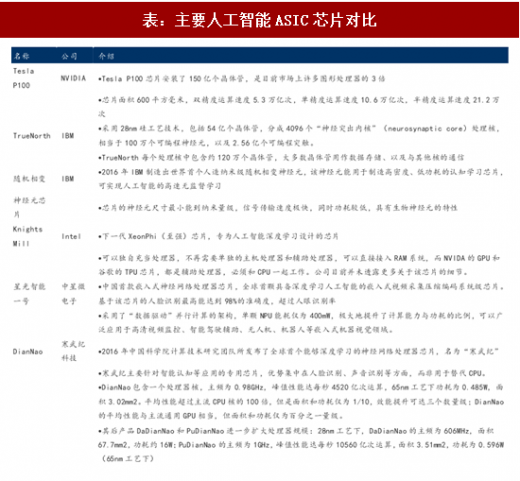

ASIC:功能特定的最优功耗AI芯片。ASIC(ApplicationSpecificIntegratedCircuit)是一种为专门目的而设计的集成电路。专为特定目的而设计,无法重新编程,效能高功耗低,但价格昂贵。Google的TPU就属于ASIC,因Google规模够大,相关的一次性工程费用可以透过省下的功耗成本加以补贴。

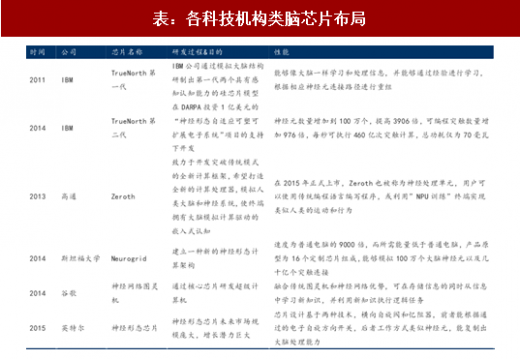

科技巨头纷纷在ASIC深度学习芯片上发力。传统的神经网络算法在通用芯片(CPU和GPU)上效率不高,功耗比较大,因此从芯片的设计角度来说,通用型往往意味着更高的成本。于是出现了特定的算法加速器,来加速包括卷积神经网络、递归神经网络在内的各种神经网络算法,专用芯片的最大优势在于其成本和功耗降低。专用深度学习芯片将大幅提升人工智能算法运行效率,推动人工智能产业加速发展。

性能上看,ASIC全面领先GPU/FPGA。CPU/GPU/NPU/TPU/XPU的论文表明,ASIC无论面积、峰值运算、功耗都优于GPU、FPGA,DIANNAO系列总体能耗更能达到百倍级GPU从应用场景来看寒武纪DIANNAO系列芯(DIANNAO/DADIANNAO/SHIDIANNAO)应用场景全面。

我们得出以下观点:

GPU在训练层应用广泛,ASIC在执行层表现较好。根据GoogleTPU论文,训练层神经网络以浮点计算为主,同时已经形成完整生态系统2。所以GPU较适合。在应用层面,无论TPU、NPU能耗均可达到30-80倍K80GPU水平(优化后可达到70-200倍)

GPU、TPU和NPU,适合的人工智能操作也不同。GPU的计算能力最强,适合所有操作;TPU主要从事多层神经网络(MLP)、长短期记忆网络(LSTM),因为谷歌认为这是其最实用的AI操作(谷歌称“多层感知(MLP)占GoogleAI开发工作的61%。虽然大部份的架构师一直在加速CNN设计,但这部份只占5%的工作负载”);NPU主要优化了卷积(Conv)和池化(Pool)

不同种类的芯片适用于不同的场景。GPU和CPU适合消费和企业级;FPGA更适用于企业用户,尤其是对芯片的可重配置需求较高的军工和工业电子领域,非常适合在云端数据中心部署;ASIC如能达到量产,成本相对FPGA方案较低,能耗更更适用于消费级市场。ASIC具体来看,TPU适合搜索/翻译/相册等;DIANNAO系列覆盖所有神经网络应用。

【版权提示】观研报告网倡导尊重与保护知识产权。未经许可,任何人不得复制、转载、或以其他方式使用本网站的内容。如发现本站文章存在版权问题,烦请提供版权疑问、身份证明、版权证明、联系方式等发邮件至kf@chinabaogao.com,我们将及时沟通与处理。